AWS IoT TwinMaker 정식 출시 – 디지털 트윈 서비스

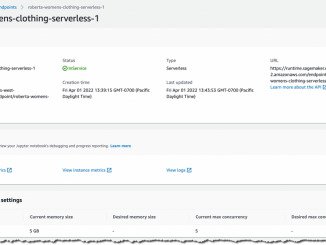

AWS IoT TwinMaker 정식 출시 – 디지털 트윈 서비스 작년 AWS re:Invent 2021에서는 실제 시스템의 디지털 트윈을 더 빠르고 쉽게 생성하고 이를 사용하여 산업 운영을 모니터링하고 최적화할 수 있는 새로운 AWS IoT 서비스인 AWS IoT TwinMaker의 평가판을 소개했습니다. 디지털 트윈은 비즈니스 성과를 창출하기 위해 물리적 시스템의 실제 구조, 상태, 동작을 모방하도록 데이터를 이용해 동적으로 업데이트되는 개별 물리적 시스템의 살아있는 디지털 표현입니다. 디지털 트윈은 건물, 공장, 산업 장비, 생산 라인과 같은 시스템 또는 자산의 전체 수명 주기에 걸쳐 다양한 사용 사례에 적용할 수 있습니다. 많은 고객이 아직 디지털 트윈 여정의 초기 단계에 있습니다. 이들은 서로 다른 소스에서 데이터를 연결하고 대시보드나 몰입형 환경에서 해당 데이터를 상황에 맞게 시각화하여 비즈니스 가치와 성과를 실현할 수 있도록 열심히 노력하고 있습니다. 오늘 AWS Summit 샌프란시스코에서 새로운 기능, 개선 사항, 추가 AWS 리전에서의 가용성과 함께 AWS IoT TwinMaker의 정식 출시를 발표합니다. AWS IoT TwinMaker는 여러 소스의 기존 [ more… ]