amazon web service

Amazon FSx for Lustre용 File Release 신규 기능 출시

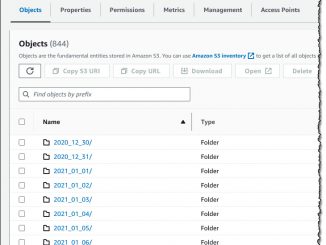

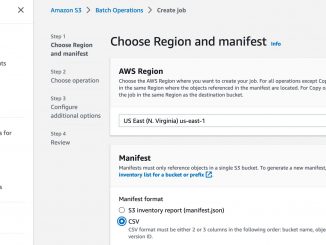

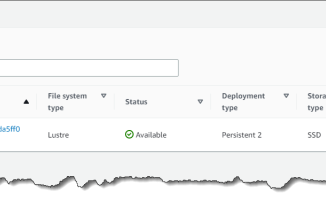

Amazon FSx for Lustre용 File Release 신규 기능 출시 Amazon FSx for Lustre는 Linux 기반 워크로드를 지원하기 위해 오픈 소스 Lustre 파일 시스템의 확장성 및 고성능을 갖춘 완전관리형 공유 스토리지를 제공합니다. FSx for Lustre는 스토리지 속도와 처리량이 중요한 워크로드에 적합합니다. FSx for Lustre를 사용하면 스토리지 병목 현상을 방지하고, 컴퓨팅 리소스의 활용도를 높이고, 인공 지능(AI) 및 기계 학습(ML), 고성능 컴퓨팅(HPC), 재무 모델링, 미디어 처리를 비롯한 워크로드의 가치 창출 시간을 단축할 수 있기 때문입니다. FSx for Lustre는 기본적으로 Amazon Simple Storage Service(S3)와 통합되어 자동 가져오기 및 내보내기를 통해 양방향으로 변경 사항을 동기화합니다. 따라서 고성능 POSIX 준수 파일 시스템을 통해 온디맨드로 Amazon S3 데이터 레이크에 액세스할 수 있습니다. 오늘 부터 FSx for Lustre용 File Release (파일 릴리스) 기능을 출시합니다. 이 기능을 사용하면 Amazon S3와 동기화된 파일 데이터를 릴리스하여 데이터 수명 주기를 관리할 수 있습니다. 파일 릴리스는 스토리지 공간을 확보하므로 Amazon S3에서 FSx for [ more… ]